24 Zbieżność według rozkładu

Twierdzenie de Moivre’a - Laplace’a mówi, że odpowiednio znormalizowany rozkład \({\rm Bin(n,1/2)}\) zbiega w pewnym sensie do rozkładu normalnego. Podczas zajęć pojawiły się również podobne przykłady, np. Twierdzenie Poissona mówiło, że rozkład \({\rm Bin}(n,p_n)\) zbiega do rozkładu \({\rm Pois}(\lambda)\), gdy \(np_n\to\lambda\).

Chcemy zdefiniować pojęcie zbieżności rozkładów zmiennych losowych. Innymi słowy, ponieważ rozkłady są miarami probabilistycznymi na \(\mathbb{R}\), chcemy zrozumieć co oznacza, że ciąg miar \(\mu_n\) zbiega do \(\mu\). Co oznacza, że dwie miary są blisko siebie? Najbardziej naturalnie byłoby powiedzieć, że \(\mu_n\to \mu\), gdy dla każdego zbioru borelowskiego \(A\in \mathcal{B}or(\mathbb{R})\), \(\mu_n(A)\to \mu(A)\). Okazuje się jednak, że takie podejście jest niewłaściwe i tak wprowadzona zbieżność nie ma dobrych własności (np. jest trudna do sprawdzenia i operowania).

Przykład 24.1 Niech \(\{X_n\}_{n \in \mathbb{N}}\) będzie ciągiem niezależnych zmiennych losowych takich, że \[\begin{equation*} \mathbb{P}[X_j=1]=\mathbb{P}[X_j=-1] =1/2. \end{equation*}\] Wówczas dla \(S_n = \sum_{j=1}^nX_j\) mamy \[\begin{equation*} \lim_{n \to \infty} \mathbb{P}\left[S_n/\sqrt{n} \in [a,b] \right] = \int_a^b \frac 1{\sqrt{2\pi}} e^{-x^2/2} \mathrm{d}x. \end{equation*}\] Jednak dla przeliczalnego zbioru \[\begin{equation*} A = \bigcup_{k\geq 1} \mathbb{Z}/\sqrt{k} \end{equation*}\] mamy \[\begin{equation*} \mathbb{P}\left[S_n/\sqrt{n} \in A \right] = 1 \end{equation*}\] ale \[\begin{equation*} \int_A \frac 1{\sqrt{2\pi}} e^{-x^2/2} \mathrm{d}x=0. \end{equation*}\]

Widzimy więc, że do zagadnienia zbieżności miar należy podejść ostrożnie. Zrobimy więc krok w tył i zastanowimy się najpierw w jaki sposób możemy rozróżnić miarę.

24.1 Rozróżnianie miar

Definicja 24.1 Niech \(\vec{X}\) i \(\vec{Y}\) będą \(d\)-wymiarowymi wektorami losowymi. Powiemy, że \(\vec{X}\) i \(\vec{Y}\) mają ten sam rozkład, jeżeli \(\mu_{\vec{X}} = \mu_{\vec{Y}}\). Piszemy wtedy \(\vec{X} \stackrel{d}{=} \vec{Y}\).

Jeżeli \(\mu\) oraz \(\nu\) są rozkładami prawdopodobieństwa na \(\mathbb{R}^d\) to powiemy, że są one równe, jeżeli są równe jako odwzorowania \(\mathcal{B}or(\mathbb{R}^d) \to [0,1]\). Dokładniej \(\mu = \nu\) wtedy gdy \[\begin{equation*} \nu(A) = \mu(A) \end{equation*}\] dla każdego borelowskiego \(A \subseteq \mathbb{R}^d\). Klasa \(\mathcal{B}(\mathbb{R}^d)\) jest stosunkowo duża i w wielu przypadkach obliczenie \(\nu(A)\) jest kłopotliwe. Chcemy więc znaleźć prostszą klasę \(\mathcal{C} \subset \mathcal{B}or(\mathbb{R}^d)\) na której możemy testować równość miar.

Lemma 24.1 Załóżmy, że \(\mathcal{C}\) jest \(\pi\)-układem generującym \(\mathcal{B}or(\mathbb{R}^d)\). Jeżeli \(\nu(C) = \mu(C)\) dla każdego \(C \in \mathcal{C}\), to \(\nu=\mu\).

Proof. Dowód przebiega tak samo jak dowód Twierdzenia o jednoznaczności. Przypomnijmy, że wystarczy sprawdzić, że \[\begin{equation*} \mathcal{L} = \left\{ A \in \mathcal{B}or(\mathbb{R}^d) \: : \: \nu(A) = \mu(A) \right\} \end{equation*}\] jest \(\lambda\)-układem. Skoro \(\mathcal{C} \subseteq \mathcal{L}\), to \(\mathcal{B}or(\mathbb{R}^d) = \mathcal{L}\).

□

Z powyższego lematu płynie prosty wniosek.

Wniosek 24.1 Jeżeli \(\mu\) i \(\nu\) są rozkładami na \(\mathbb{R}\) takimi, że dla każdych \(a<b\), \(\nu((a,b)) = \mu((a,b))\), to \(\nu=\mu\).

Podobny wniosek można napisać o przedziałach domkniętych. Z rozkładami związana jest też operacja całkowania. Dla każdej ograniczonej borelowskiej \(f \colon \mathbb{R}^d \to \mathbb{R}\) całka \[\begin{equation*} \int_{\mathbb{R}^d} f(x) \nu(\mathrm{d}x) \end{equation*}\] jest zbieżna. Okazuje się, że znajomość wartości całki dla dostatecznie bogatej rodziny funkcji wystarcza do rozróżnienia miary

Lemma 24.2 Załóżmy, że \[\begin{equation*} \int_{\mathbb{R}^d} f(x) \nu(\mathrm{d}x) = \int_{\mathbb{R}^d} f(x) \mu(\mathrm{d}x) \end{equation*}\] dla każdej ograniczonej borelowskiej funkcji \(f \colon \mathbb{R}^d \to \mathbb{R}\). Wówczas \(\nu = \mu\).

Proof. Zauważmy, że dla \(A \in \mathcal{B}or(\mathbb{R}^d)\) funkcja \(f(x) = \mathbf{1}_A(x)\) jest borelowska i ograniczona oraz \[\begin{equation*} \nu(A)=\int_{\mathbb{R}^d} f(x) \nu(\mathrm{d}x) = \int_{\mathbb{R}^d} f(x) \mu(\mathrm{d}x) = \mu(F). \end{equation*}\] □

Klasa wszystkich ograniczonych funkcji borelowskich, podobnie jak samych zbiorów borelowskich, jest niepraktyczna. Wygodniej jest pracować z ciągłymi funkcjami ograniczonymi. Oznaczmy \[ C_b\left(\mathbb{R}^d\right) = \left\{ f:\mathbb{R}^d\to\mathbb{R}, f \mbox{ jest ciągła i ograniczona} \right\}. \]

Lemma 24.3 Załóżmy, że \[\begin{equation*} \int_{\mathbb{R}^d} f(x) \nu(\mathrm{d}x) = \int_{\mathbb{R}^d} f(x) \mu(\mathrm{d}x) \end{equation*}\] dla każdej \(f \in C_b(\mathbb{R}^d)\). Wówczas \(\nu = \mu\).

Proof. Pokażemy, że \(\nu(F) = \mu(F)\) dla każdego domkniętego \(F \subseteq \mathbb{R}^d\). Ustalmy takie \(F\). Dla \(x \in \mathbb{R}^d\) niech \[\begin{equation*} \mathrm{dist}(x, F) = \inf_{f \in F} \|x-f\|. \end{equation*}\] Skoro \(F\) jest domknięty, to \(x \in F\) wtedy i tylko wtedy, gdy \(\mathrm{dist}(x, F)=0\). Niech \[\begin{equation*} f_n(x) = ( 1-n\mathrm{dist}(x,F))_+. \end{equation*}\] Wówczas \(f_n(x) \to \mathbf{1}_F(x)\). Zauważmy, że korzystamy tutaj z tego, że \(F\) jest domknięty. Z założenia \[\begin{equation*} \int_{\mathbb{R}^d} f_n(x) \nu(\mathrm{d}x) = \int_{\mathbb{R}^d} f_n(x) \mu(\mathrm{d}x) \end{equation*}\] dla każdego \(n \in \mathbb{N}\). Przechodząc do granicy i korzystając z twierdzenia o zbieżności ograniczonej \[\begin{equation*} \nu(F)=\int_{\mathbb{R}^d} \mathbf{1}_F(x) \nu(\mathrm{d}x) = \int_{\mathbb{R}^d} \mathbf{1}_F(x) \mu(\mathrm{d}x) = \mu(A). \end{equation*}\] □

24.2 Słaba zbieżność

Zastanówmy się przez chwilę, jaki test na zbieżność miar byłby najwygodniejszy. Jedyny warunek brzegowy jaki stawiamy jest to że ciąg miar \(\delta_{(-1)^n/n}\) skupionych w punktach \((-1)^n/n\) dla \(n \in \mathbb{N}\) powinien być zbieżny do miary \(\delta_0\) skupionej w \(0\).

Sprawdźmy najpierw jak zachowuje się ten ciąg przy całkowaniu zbiorów otwartych. Zauważmy, że \[\begin{align*} &\delta_{(-1)^n/n}(0,1) = (1+(-1)^n)/2 & \delta_0(0,1) =0\\ &\delta_{(-1)^n/n}(\{0\}) = 0 & \delta_0(\{0\}) =1. \end{align*}\] Okazuje się, że ciągi \(\delta_{(-1)^n/n}(A)\) nie muszą być zbieżne. Jeżeli są zbieżne, to granica nie musi być równa \(\delta_0(A)\). Okazuje się jednak, że sytuacja nie jest aż tak dramatyczna i możliwe jest opisanie asymptotycznego zachowania \(\delta_{(-1)^n/n}(A)\) w terminach \(\delta_0(A)\). Opis ten wymaga jednak informacji o topologicznych własnościach \(A\).

W przypadku funkcji ciągłych sprawa jest o wiele prostsza. Dla dowolnej \(f \in C_n(\mathbb{R})\) mamy bowiem \[\begin{equation*} \int_{\mathbb{R}} f(x) \delta_{(-1)^n/n} (\mathrm{d}x) = f((-1)^n/n) \to f(0) = \int_\mathbb{R} f(x) \delta_0(\mathrm{d}x). \end{equation*}\] Funkcje ciągłe są zatem niewrażliwe na małe wahania miar. Są dobrą klasą do testowania zbieżności miar.

Definicja 24.2 Niech \(\{\mu_n\}_{n \in \mathbb{N}}\) będzie ciągiem miar probabilistycznych na \(\mathcal{B}or(\mathbb{R}^d)\). Mówimy, że \(\mu_n\) zbiegają słabo do miary probabilistycznej \(\mu\) jeżeli dla każdej funkcji \(f\in C_b(\mathbb{R}^d)\) \[ \int_{\mathbb{R}^d} f(x)\mu_n(\mathrm{d}x) \to \int_{\mathbb{R}^d} f(x)\mu(\mathrm{d}x). \] Piszemy wtedy \(\mu_n\Rightarrow \mu\).

Przykład 24.2 Niech \(a_n\to a\in \mathbb{R}\). Wtedy \(\delta_{a_n}\Rightarrow \delta_a\), bo dla każdej funkcji \(f\in C_b(\mathbb{R})\) \[ \int_\mathbb{R} f(x) \delta_{a_n}(\mathrm{d}x) = f(a_n)\to f(a) = \int_\mathbb{R} f(x)\delta_a(\mathrm{d}x). \]

Przykład 24.3 Zdefiniujmy ciąg miar probabilistycznych \[ \mu_n\bigg(\bigg\{ \frac kn \bigg\}\bigg) = \frac 1n, \qquad k\in\{1,2,\ldots,n\}. \] Wtedy dla \(f\in C(\mathbb{R})\) \[ \int_\mathbb{R} f(x)\mu_n(dx) = \sum_{k=1}^n f\bigg(\frac kn \bigg) \cdot \frac 1n \to \int_0^1 f(x)dx, \] gdzie zbieżność wynika z własności całki Riemanna. Zatem \(\mu_n\) zbiegają słabo do miary Lebesgue’a na \([0,1]\).

Przykład 24.4 Niech \(n \in \mathbb{N}\). Z liczb \(\{1, \ldots n\}\) losujemy bez zwracania dwie liczby. Niech \(X_n\) będzie większą z nich. Wówczas \[\begin{equation*} \mathbb{P}[X_n=k] = \frac{2(k-1)}{n(n-1)}. \end{equation*}\] Niech \(\mu_n\) będzie rozkładem zmiennej \(X_n/n\). Wówczas dla każdej \(f \in C_b(\mathbb{R})\), \[\begin{align*} \int_\mathbb{R} f(x) \mu_n(\mathrm{d}x) & = \sum_{k} f(k/n) \mathbb{P}[X_n/n=k/n] \\ & = \sum_{k=2}^n f(k/n) \frac{2(k-1)}{n(n-1)} \to \int_0^1 f(x) 2x \mathrm{d}x. \end{align*}\] Miary \(\mu_n\) zbiegają zatem słabo do miary \(\mu\) o gęstości \(2x \mathbf{1}_{[0,1]}(x)\).

Twierdzenie 24.1 (Portmanteau) Niech \(\mu_n,\mu\) będą miarami probabilistycznymi na \((\mathbb{R}^d,\mathcal{B}or(\mathbb{R}^d))\). Następujące warunki są równoważne

- \(\mu_n \Rightarrow\mu\);

- dla każdej funkcji \(f\in C_b(\mathbb{R}^d)\) i jednostajnie ciągłej: \[\int_{\mathbb{R}^d} f(x)\mu_n(dx) \to \int_{\mathbb{R}^d} f(x)\mu(dx);\]

- dla każdego domkniętego zbioru \(F\subset \mathbb{R}^d\): \[\limsup_{n\to \infty} \mu_n(F) \le \mu(F);\]

- dla każdego otwartego zbioru \(G\subset \mathbb{R}^d\): \[\liminf_{n\to \infty} \mu_n(G) \ge \mu(G);\]

- dla każdego zbioru \(A\in \mathcal{B}or(\mathbb{R}^d)\) takiego, że \(\mu(\partial A)=0\): \[\lim_{n\to\infty} \mu_n(A) = \mu(A).\]

Remark. Przypomnijmy, że zbiór \(G \subseteq \mathbb{R}^d\) nazywamy otwartym jeżeli dla każdego punktu \(x \in G\) istnieje kula o dostatecznie małym promieniu \(\epsilon>0\) i środku w punkcie \(x\), \[\begin{equation*} B(x, \epsilon) = \left\{ y \in \mathbb{R}^d \: : \: \|x-y\| < \epsilon \right\} \end{equation*}\] taka, że \(B(x,\epsilon) \subseteq G\). Dla zbioru \(A \subseteq \mathbb{R}^d\) przez \(A^\circ = \mathrm{int}(A)\) oznaczamy największy zbiór otwarty zawarty w \(A\).

Zbiór \(F \subseteq \mathbb{R}^d\) nazywamy domkniętym, jeżeli jego dopełnienie \(F^c = \mathbb{R}^d\setminus F\) jest otwarte. Równoważnie \(F\) jest domknięty, jeżeli dla każdego punktu spoza \(F\), \(x \notin F\) istnieje kula o środku w punkcie \(x\) i promieniu \(\epsilon\) rozłączna z \(F\), \(B(x, \epsilon) \cap F =\emptyset\). Jeżeli \(A \subseteq \mathbb{R}^d\), to przez \(\overline{A} = \mathrm{cl}(A)\) oznaczamy najmniejszy zbiór domknięty zawierający \(A\). Dodatkowo \(\overline{A}\) jest zbiorem wszystkich granic dla ciągów zawartych w \(A\).

Wreszcie dla \(A \subseteq \mathbb{R}^d\) określamy jego brzeg przez \[\begin{equation*} \partial(A) = \mathrm{fr}(A) = \mathrm{bd}(A) = \mathrm{cl}(A) \setminus \mathrm{int}(A). \end{equation*}\] Zbiór \(\partial A\) składa się z punktów, które są granicami ciągu zawartego w \(A\) i ciągu zawartego w \(A^c\).

Remark. Portmanteau to zapożyczone z francuskiego określenie skórzanej walizki podróżnej na ubrania (porter (nosić) + manteau płaszcz).

Proof. \(1\rightarrow 2\). Oczywiste.

\(2\rightarrow 3\). Ustalmy dowolny zbiór domknięty \(F\). Dla \(\varepsilon>0\) oznaczmy przez \[ F_{\varepsilon} = \big\{ x\in \mathbb{R} : d(x,F) < \varepsilon\big\} \] \(\varepsilon\)-otoczkę zbioru \(F\).

Ustalmy \(\delta > 0\) i weźmy \(\varepsilon>0\) taki, że \[ \mu(F_\varepsilon) <\mu(F) + \delta. \] Taki \(\varepsilon\) musi istnieć, gdyż z domkniętości zbioru \(F\): \(F = \bigcap_{n=1}^{\infty} F_{\frac 1n}\), a z lematu o ciągłości miary \(\mu(F_{\frac 1n})\to \mu(F)\). Niech \(f\) będzie jednostajnie ciągłą funkcją taką, że \[ {\bf 1}_F \le f \le {\bf 1}_{F_{\varepsilon}} \] można np. przyjąć \[ f(x) = (1-d(x,F)/\varepsilon))_+. \] Wówczas odwołując się do punktu \(2.\) \[ \limsup \mu_n(F) \le \limsup \int f d\mu_n = \int f d\mu \le \mu(F_{\varepsilon}) \le \mu(F)+\delta. \] Z dowolności \(\delta\) otrzymujemy tezę.

\(3\leftrightarrow 4\). Dowód równoważności wynika z wzięcia dopełnienia zbioru.

\(4,3\rightarrow 5\) Niech \(A \in \mathcal{B}or(\mathbb{R}^d)\) będzie taki, że \(\mu(\partial(A))=0\). Mamy \[\begin{align*} \mu(\mathrm{cl}(A)) & \geq \limsup_{n \to \infty} \mu_n(\mathrm{cl}(A)) \\ & \geq \limsup_{n \to \infty} \mu_n(A) \\ & \geq \liminf_{n \to \infty} \mu_n(\mathrm{int}(A)) \\ & \geq \mu(\mathrm{int}(A)). \end{align*}\] Zauważmy jednak, że \(\mu(\mathrm{cl}(A)) = \mu(\partial (A)) + \mu(\mathrm{int}(A)) = \mu(\mathrm{int}(A))\). Zatem wszystkie granice powyżej są sobie równe.

\(5 \rightarrow 1\) Wybierzmy \(f \in C_b(\mathbb{R}^d)\). Z liniowości całki bez zmniejszania ogólności możemy założyć, że \(f\geq 0\). Wówczas dla dowolnego \(x \in \mathbb{R}^d\), \[\begin{equation*} f(x) = \int_0^{f(x)} \mathrm{d}t = \int_0^\infty \mathbf{1}_{\{ f(x) >t\}}(t) \mathrm{d}t. \end{equation*}\] Stąd \[\begin{equation*} \int_{\mathbb{R}^d} f(x) \mu(\mathrm{d} x) = \int_0^1 \mu[x \: : \: f(x)>t] \mathrm{d} t. \end{equation*}\] Niech \[\begin{equation*} B_t = \left\{ x\in \mathbb{R}^d \: : \: f(x) >t \right\}. \end{equation*}\] Zauważmy, że z ciągłości \(f\), \[\begin{equation*} {\rm cl} \{ x \: : \: f(x)>t \} \subseteq \{ x \: : \: f(x)\geq t \} \end{equation*}\] oraz, skoro przeciwobrazy przez \(f\) zbiorów otwartych są otwarte \[\begin{equation*} {\rm int} \{ x \: : \: f(x)>t \} = \{ x \: : \: f(x)> t \} . \end{equation*}\] Stąd \[\begin{equation*} \partial B_t=\partial \{ x \: : \: f(x)>t \} \subseteq \{ x \: : \: f(x)= t \}. \end{equation*}\] Zauważmy, że zbiory \(A_t = \{ x \: : \: f(x)= t \}\) są parami rozłączne i wypełniają całe \(\mathbb{R}^d\). Wówczas \(\mu(A_t)>0\) tylko dla przeliczalnie wielu \(t \in \mathbb{R}\) (jest co najwyżej \(n\in \mathbb{N}\) zbiorów postaci \(A_t\) dla których \(\mu(A_t) > 1/n\)). Oznacza to, że \(\mu(\partial B_t) =0\) dla prawie wszystkich \(t\) (wszystkich poza przeliczalną ilością). Z punktu 4 \[\begin{equation*} \mu_n(B_t) \to \mu(B_t) \end{equation*}\] \(\lambda_1\) -p.w. Stąd na mocy twierdzenia o zbieżności ograniczonej \[\begin{align*} \int f(x) \mu_n(\mathrm{d}x) & = \int_0^\infty \mu_n (x \: : \: f(x) >t) \mathrm{d} t \\ & \to \int_0^\infty \mu (x \: : \: f(x) >t) \mathrm{d} t \\ & = \int f(x) \mu(\mathrm{d}x). \end{align*}\] □

Twierdzenie 24.2 Niech \(\{\mu_n\}_n,\mu\) będą rozkładami prawdopodobieństwa na \(\mathbb{R}\) o dystrybuantach odpowiednio \(\{F_n\}_n,F\). Wówczas \(\mu_n\Rightarrow \mu\) wtedy i tylko wtedy, gdy \(F_n(x)\to F(x)\) dla każdego punktu \(x\), w którym \(F\) jest ciągła.

Proof. Załóżmy, że \(\mu_n\Rightarrow \mu\). Niech \(x\) będzie punktem ciągłości \(F\). Zdefiniujmy \(A = (-\infty,x]\), wówczas \(\partial A = \{x\}\) i \(\mu(\partial A) = 0\). Zatem \[ F_n(x) = \mu_n(A) \to \mu(A) = F(x). \]

Załóżmy teraz, że \(F_n(x)\to F(x)\) dla każdego punktu \(x\), w którym \(F\) jest ciągła. Niech \(G\subset \mathbb{R}\) będzie dowolnym otwartym zbiorem. Wówczas możemy \(G\) przedstawić w postaci \[ G = \bigcup_{k=1}^\infty I_k, \] gdzie \(I_k = (a_k,b_k)\) są rozłącznymi przedziałami (suma może też być skończona). Ustalmy \(\varepsilon>0\) i wybierzmy punkty ciągłości \(a_k', b_k'\in (a_k,b_k)\) tak, aby \[ F(b_k') - F(a_k') = \mu(a_k',b_k') \ge \mu(I_k) - \varepsilon 2^{-k}. \] Takie punkty istnieją z lematu o ciągłości miary oraz obserwacji, że \(F\) ma co najwyżej przeliczalnie wiele punktów nieciągłości.

Wówczas dla ustalonego \(m\): \[\begin{align*} \liminf_{n\to\infty} \mu_n(G) & \ge \liminf_{n\to\infty} \sum_{k=1}^m \big( F_n(b_k') - F_n(a_k') \big) \\ & = \sum_{k=1}^m \big( F(b_k') - F(a_k') \big) \\ & \ge \mu\bigg( \bigcup_{k=1}^m I_k \bigg) - \varepsilon. \end{align*}\] Z dowolności \(m\) i lematu o ciągłości miary: \[ \liminf_{n\to\infty} \mu_n(G) \ge \mu(G) -\varepsilon. \] Następnie z dowolności \(\varepsilon\), przechodząc z tym parametrem do 0, otrzymujemy \[ \liminf_{n\to\infty} \mu_n(G) \ge \mu(G). \] Zatem z twierdzenia 24.1, \(\mu_n\Rightarrow \mu\).

Przykład 24.5 Niech \(a_n\to a\in \mathbb{R}\). Wtedy \(\delta_{a_n}\Rightarrow \delta_a\), bo dystrybuanta \(F\) miary \(\delta_a\) ma tylko jeden punkt nieciągłości: \(a\). Dla każdego \(x\not= a\), \(F_n(x)\to F(x)\)

Przykład 24.6 Niech \[ \mu_n\bigg(\bigg\{ \frac kn \bigg\}\bigg) = \frac 1n. \] i \(\mu = {\bf 1}_{[0,1]}(x)dx\). Wykazana przez nas wcześniej zbieżność \(\mu_n\Rightarrow \mu\) wynika z powyższego twierdzenia i poniższego rysunku, na którym w kremowym beżu zaznaczono dystrybuantę \(F\), a w kolorze morskiego turkusu dystrybuantę \(\mu_n\).

Przykład 24.7 Rozważmy zmienne losowe \(\{X_n\}_{n \in \mathbb{N}}\) takie, że dla każdego \(n \in \mathbb{N}\) ma rozkład geometryczny z parametrem \(1/n\), \[\begin{equation*} \mathbb{P}\left[ X_n=k \right] = \left( 1-1/n\right)^{k-1}/n. \end{equation*}\] Niech \(\mu_n\) będzie rozkładem zmiennej losowej \(X_n/n\). Wówczas dla każdego \(t\in \mathbb{R}\), \[\begin{align*} \mu_n((t,+\infty)) & = \mathbb{P}[X_n> tn] \\ & = \mathbb{P}[X_n \geq [tn]+1] \\ & = (1-1/n)^{[1n]+1} \to e^{-t}. \end{align*}\] Powyższe jest równoważne zbieżności dystrybuant. Oznacza to, że \(\mu_n \Rightarrow \mathrm{Exp}(1)\). Zbieżność tę widać na rysunku poniżej.

24.3 Zbieżność według rozkładu

Wiele naturalnych rozkładów najwygodniej jest zdefiniować w terminach zmiennych losowych. Aby uprościć notację w takich przypadkach, zbieżność ich rozkładów będziemy wysławiali w terminach tych właśnie zmiennych.

Definicja 24.3 Mówimy, że ciąg wektorów losowych \(\{\vec{X}_n\}_{n \in \mathbb{N}}\) zbiega według rozkładu do wektora losowego \(\vec{X}\), jeżeli \(\mu_{\vec{X}_n} \Rightarrow \mu_\vec{X}\), czyli \[\begin{equation*} \mathbb{E} \left[ f\left(\vec{X}_n\right) \right] \to \mathbb{E}\left[ f\left(\vec{X}\right) \right] \end{equation*}\] dla każdej \(f \in C_b(\mathbb{R}^d)\).

W naturalny sposób Twierdzenie 24.1 można przepisać w terminach zmiennych losowych.

Twierdzenie 24.3 Niech \(\{\vec{X}_n\}_{n \in \mathbb{N}}\), \(\vec{X}\) będą \(d\)-wymiarowymi wektorami losowymi. Następujące warunki są równoważne

- \(\vec{X}_n \Rightarrow \vec{X}\);

- dla każdej funkcji \(f\in C_b(\mathbb{R}^d)\) i jednostajnie ciągłej: \[ \lim_{n \to \infty}\mathbb{E} \left[ f\left(\vec{X}_n\right) \right] = \mathbb{E}\left[ f\left(\vec{X}\right) \right] \]

- dla każdego domkniętego zbioru \(F\subset \mathbb{R}^d\): \[\limsup_{n\to \infty} \mathbb{P}\left[ \vec{X}_n \in F \right] \le \mathbb{P}\left[ \vec{X} \in F \right];\]

- dla każdego otwartego zbioru \(G\subset \mathbb{R}^d\): \[\liminf_{n\to \infty} \mathbb{P}\left[ \vec{X}_n \in G \right] \ge \mathbb{P}\left[ \vec{X} \in G \right];\]

- dla każdego zbioru \(A\in \mathcal{B}or(\mathbb{R}^d)\) takiego, że \(\mathbb{P}\left[ \vec{X} \in \partial A\right]=0\): \[ \lim_{n\to \infty} \mathbb{P}\left[ \vec{X}_n \in A \right] = \mathbb{P}\left[ \vec{X} \in A \right];\]

Często będziemy używać nieco innej notacji i np. pisać \(X_n \Rightarrow \mu\), co oznacza, że \(X_n\) zbiegają do według rozkładu do pewnej zmiennej losowej o rozkładzie \(\mu\).

Przykład 24.8 Niech \(\{X_n\}\) będzie ciągiem niezależnych zmiennych losowych takich, że \(\mathbb{P}[X_n = 1] = \mathbb{P}[X_n=-1] = 1/2\) i niech \(S_n = X_1+\ldots+ X_n\). Wówczas ciąg zmiennych losowych \(S_n/\sqrt n\) zbiega według rozkładu do \(\mathcal{N}(0,1)\), co wynika z twierdzenia de Moivre’a - Laplace’a

Zbieżność według rozkładu jest najsłabszą z poznanych do tej pory zbieżności.

Lemma 24.4 Niech \(\{X_n\}, \{Y_n\}\) będą ciągiem zmiennych losowych. Wówczas

- jeżeli \(X_n \overset{\mathbb{P}}{\to} X\), to \(X_n \overset{d}{\to} X\);

- jeżeli \(X_n \overset{d}{\to} X\) i \(\mathbb{P}[X=c]=1\), to \(X_n \overset{\mathbb{P}}{\to} c\);

- jeżeli \(X_n \overset{d}{\to} X\), to \(aX_n+b \overset{d}{\to} aX+b\), dla \(a,b\in\mathbb{R}\);

- jeżeli \(X_n \overset{d}{\to} X\), \(Y_n \overset{d}{\to} c\), to \(X_n +Y_n\overset{d}{\to} X + c\) oraz \(X_n Y_n\overset{d}{\to} cX\).

Dowód powyższego lematu pozostawiamy jako ćwiczenie.

Zbieżność według rozkładu nie implikuje zbieżności według prawdopodobieństwa, czy też zbieżności p.n. Można to zaobserwować na poniższym przykładzie.

Przykład 24.9 Rozważmy przestrzeń probabilistyczną \(([0,1], \mathcal{B}or([0,1]), {\rm Leb})\). Zdefiniujmy ciąg zmiennych losowych \(X_{2n-1} = {\bf 1}_{[0,1/2]}\), \(X_{2n}= {\bf 1}_{[1/2,1]}\). Wówczas ciąg \(X_n\) nie jest zbieżny ani punktowo, ani według prawdopodobieństwa, ale dla każdego \(n\), \(X_n\) ma rozkład \(\frac 12 \delta_0 + \frac 12 \delta _1\), zatem \[ X_n \Rightarrow \frac 12 \delta_0 + \frac 12 \delta _1 \]

Powyższy przykład pokazuje, że zbieżność według rozkładu nie implikuje zbieżności p.n., ale zachodzi następujący wynik:

Twierdzenie 24.4 (Skorochoda) Załóżmy, że \(\{\vec{X}_n\}_{n \in \mathbb{N}}\) jest ciągiem wektorów losowych takich, że \(\vec{X}_n \Rightarrow \vec{X}\) dla pewnego wektora losowego \(\vec{X}\). Istnieje przestrzeń probabilistyczna \((\Omega', \mathcal{F}', \mathbb{P}')\) oraz określone na niej wektory losowe \(\{\vec{X}'_n\}_{n \in \mathbb{N}}\) oraz \(X'\) takie, że \(\vec{X}_n \overset{d}= \vec{X}'_n\), \(\vec{X} \overset{d}= \vec{X}'\) oraz \[ \vec{X}'_n \to \vec{X}'\quad \mbox{p.n.} \]

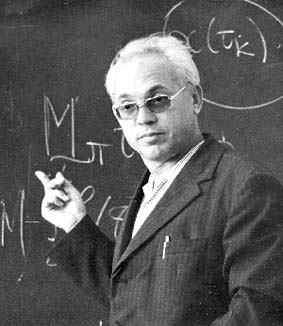

Anatolii Volodymyrovych Skorokhod (1930-2011)

Proof. Przedstawimy dowód dla \(d=1\). Niech \(F_n\) i \(F\) będą dystrybuantami odpowiednio \(X_n\) oraz \(X\). Skoro \(X_n \Rightarrow X\), to \(F_n(x) \to F(x)\) dla \(x \in \mathbb{R} \setminus \mathrm{D}_F\), gdzie \[\begin{equation*} \mathrm{D}_F = \{ x \in \mathbb{R} \: : \: \mbox{$F$ nie jest ciągła w $x$} \}. \end{equation*}\] Wiemy, że zbiór \(\mathrm{D}_F\) jest co najwyżej przeliczalny. Stąd \(F_n \to F\) prawie wszędzie względem jednowymiarowej miary Lebesgue’a. Naturalnymi kandydatami na zmienne \(X_n'\) oraz \(X'\) są zatem \[\begin{equation*} X_n'(\omega) = F_n^{-1}(\omega) = \sup \{ y \in \mathbb{R} \: : \: F_n(y) <\omega\} \end{equation*}\] oraz \[\begin{equation*} X'(\omega) = F^{-1}(\omega) = \sup \{ y \in \mathbb{R} \: : \: F(y) <\omega\}. \end{equation*}\] Należy teraz sprawdzić, że \(X_n'\to X'\) p.w.

Zaczynamy od identyfikacji zbioru na którym zachodzi zbieżność. Niech \(a_x = \sup\{ y : F(y) < x \}\), \(b_x = \inf\{ y : F(y) > x \}\), oraz \(\Omega_0 = \{ x : (a_x, b_x) = \emptyset \}\). \(\Omega - \Omega_0\) jest zbiorem przeliczalnym, ponieważ przedziały \((a_x, b_x)\) są rozłączne i każdy niepusty przedział otwarty zawiera liczbę wymierną. Jeśli \(x \in \Omega_0\), to \(F(y) < x\) dla \(y < F^{-1}(x)\) oraz \(F(z) > x\) dla \(z > F^{-1}(x)\). Aby pokazać, że \(F_n^{-1}(x) \to F^{-1}(x)\) dla \(x \in \Omega_0\), trzeba pokazać dwie rzeczy:

- \(\liminf_{n \to \infty} F_n^{-1}(x) \geq F^{-1}(x)\)

Dowód a. Niech \(y < F^{-1}(x)\) będzie taki, że \(F\) jest ciągła w punkcie \(y\). Ponieważ \(x \in \Omega_0\), \(F(y) < x\) i jeśli \(n\) jest dostatecznie duże, to \(F_n(y) < x\), czyli \(F_n^{-1}(x) \geq y\). Ponieważ to zachodzi dla wszystkich \(y\) spełniających zadany warunek, wynik podpunktu (a) jest dowiedziony.

- \(\limsup_{n \to \infty} F_n^{-1}(x) \leq F^{-1}(x)\)

Dowód b. Niech \(y > F^{-1}(x)\) będzie taki, że \(F\) jest ciągła w punkcie \(y\). Ponieważ \(x \in \Omega_0\), \(F(y) > x\) i dla dostatecznie dużego \(n\), \(F_n(y) > x\), czyli \(F_n^{-1}(x) \leq y\). Ponieważ to zachodzi dla wszystkich \(y\) spełniających zadany warunek, pociąga to podpunkt b.

□

Niech \(g \colon \mathbb{R}^d \to \mathbb{R}^m\) będzie mierzalną funkcją oraz niech \[\begin{equation*} \mathrm{D}_g = \left\{ x \in \mathbb{R}^d : g \text{ nie jest ciągła w } x \right\}. \end{equation*}\] Wówczas \(\mathrm{D}_g\) jest borelowskim podzbiorem \(\mathbb{R}^d\).

Twierdzenie 24.5 (Twierdzenie o odwzorowaniu ciągłym) Niech \(g\) będzie mierzalną funkcją. Jeśli \(X_n \to X_\infty\) oraz \(\mathbb{P}(X_\infty \in \mathrm{D}_g) = 0\), to wtedy \(g(X_n) \Rightarrow g(X)\).

Proof. Zastosujemy Twierdzenie Skorochoda. Niech \(Y_n \overset{d}{=} X_n\) i \(Y_n \to Y_\infty\) prawie na pewno. Jeśli \(f\) jest funkcją ciągłą, to \(\mathrm{D}_{f \circ g} \subseteq \mathrm{D}_g\), więc \(\mathbb{P}(Y_\infty \in \mathrm{D}_{f \circ g}) = 0\), a zatem \(f(g(Y_n)) \to f(g(Y_\infty))\) prawie na pewno. Jeśli dodatkowo \(f\) jest ograniczona, to z twierdzenia o zbieżności ograniczonej mamy: \[ \mathbb{E} \left[ f(g(Y_n)) \right] \to \mathbb{E} \left[ f(g(Y_\infty)) \right]. \] Ponieważ to zachodzi dla wszystkich ograniczonych ciągłych funkcji \(f\), \[ g(X_n) \Rightarrow g(X_\infty). \]

□

24.4 Ciasne rodziny miar

Podczas pierwszego kursu z analizy matematycznej dowodzi się fakt, że z ograniczonego ciągu liczb rzeczywistych zawsze można wybrać podciąg zbieżny. Ten niepozorny fakt jest bardzo użyteczny przy analizie własności funkcji ciągłych. Chcemy znaleźć analogon tej własności dla słabej zbieżności.

Definicja 24.4 Dystrybuanta ułomna jest to funkcja \(F\) spełniająca warunki:

- \(F\) jest niemalejąca;

- \(0\le F(t)\le 1\) dla każdego \(t \in \mathbb{R}\);

- \(F\) jest prawostronnie ciągła;

Z powyższej definicji wynika, że \(\lim_{t\to\infty} F(t) - \lim_{t\to -\infty} F(t) = p\le 1\), w szczególności może się zdarzyć, że \(p<1\).

Rozważamy zbiór dystrybuant ułomnych wraz ze słabą zbieżnością jak powyżej, tzn. mówimy, że ciąg dystrybuant ułomnych \(F_n\) zbiega słabo do dystrybuanty ułomnej \(F\), jeżeli \(F_n(x)\to F(x)\) dla każdego \(x\) będącego punktem ciągłości \(F\).

Twierdzenie 24.6 (Helly'ego o wyborze) Każdy ciąg dystrybuant (ułomnych) zawiera podciąg słabo zbieżny do dystrybuanty ułomnej.

Eduard Helly (1884-1943)

Proof. Pokażemy, używając metody przekątniowej, że dowolny ciąg dystrybuant zawiera podciąg, który jest zbieżny na zbiorze liczb wymiernych, czyli na gęstym podzbiorze \(\mathbb{R}\) do pewnej funkcji \(F_0\). Funkcja ta może nie być uzupełniona do dystrybuanty ułomnej liniowo.

Ustawmy w ciąg liczby wymierne: \(w_1,w_2,\ldots\) Ciąg \(F_n(w_1)\) jest ograniczony możemy więc wybrać z niego podciąg zbieżny: \(F_{n_{1,1}}(w_1), F_{n_{1,2}}(w_1), \ldots\): \[ \lim_{k\to \infty} F_{n_{1,k}}(w_1) =: F_0(w_1) \] Patrzymy teraz na ciąg dystrybuant \(\{F_{n_{1,k}}\}_k\). Ponownie, ciąg \(F_{n_{1,k}}(w_2)\) jest ograniczony, a więc zawiera podciąg zbieżny \[ \lim_{k\to \infty} F_{n_{2,k}}(w_2) =: F_0(w_2). \] Kontynuując to rozumowanie w \(j\)-tym kroku wybieramy podciąg taki, że \[ \lim_{k\to \infty} F_{n_{j,k}}(w_j) =: F_0(w_j). \] Metodą przekątniową wybieramy ciąg dystrybuant \(F_{n_{k,k}}\). Jest to ciąg, który jest zbieżny w każdym punkcie wymiernym \(w\), do \(F_0(w)\), ponieważ z konstrukcji dla każdego \(j\) ciąg \(\{F_{k,k}\}_{k\ge j}\) jest podciągiem \(\{F_{j,i}\}_i\). Funkcja \(F_0\) jest więc zdefiniowana na zbiorze liczb wymiernych i chcemy ją przedłużyć do całej prostej. Zdefiniujmy \[ F(t) =\inf\{ F_0(w): t<w\in{\mathbb Q} \}, \quad t\in\mathbb{R}. \] Wtedy \(F\) jest dystrybuantą ułomną (szczegóły pozostawiamy czytelnikowi). Pozostaje do sprawdzenia, że \(F_{n_{k,k}}\) zbiega do \(F\) we wszystkich punktach ciągłości \(F\).

Niech \(x\) będzie punktem ciągłości \(F\) i niech \(x_1,x_2, x_3\in {\mathbb Q}\) będą takie, że \(x_1< x_2 < x < x_3\), wówczas: \[ F_{n_{k,k}}(x_2) \le F_{n_{k,k}}(x) \le F_{n_{k,k}}(x_3), \] co implikuje \[\begin{multline*} F(x_1) \le F_0(x_2) \le \liminf_{k\to \infty} F_{n_{k,k}}(x_2) \le \liminf_{k\to \infty} F_{n_{k,k}}(x)\\ \le \limsup_{k\to \infty} F_{n_{k,k}}(x) \le \limsup_{k\to\infty} F_{n_{k,k}}(x_3) = F_0(x_3) \le F(x_3), \end{multline*}\] Przypomnijmy, że \(x\) jest punktem ciągłości \(F\), przechodząc więc z \(x_1 \nearrow x\) oraz \(x_3 \searrow x\), otrzymujemy \[ \lim_{k\to \infty} F_{n_{k,k}}(x) = F(x). \] □

Przykład 24.10 Niech \[ F_n(x) = \left\{ \begin{array}{cc} 0\ & x < n \\ 1\ & x\ge n \end{array} \right. \] Wtedy \(F_n(x)\to 0\), więc słabą granicą ciągu dystrybuant \(F_n\) jest dystrybuanta ułomna tożsamościowo równa \(0\).

Nieznacznie modyfikując ten przykład i definiując \[ F_n(x) = \left\{ \begin{array}{cc} 0\ & x < -n \\ 1\ & x\ge -n \end{array} \right.\] otrzymujemy ciąg dystrybuant słabo zbieżny do ułomnej dystrybuanty tożsamościowo równej 1.

Definicja 24.5 Rodzina \(\{\mu_t\}_{t\in T}\) rozkładów prawdopodobieństwa na \((\mathbb{R}^d,\mathcal{B}or(\mathbb{R}^d))\) nazywana jest ciasną jeżeli dla każdego \(\varepsilon >0\) istnieje zbiór zwarty \(K\subseteq \mathbb{R}^d\) taki, że \[ \mu_t(K) > 1-\varepsilon,\quad \forall t\in T. \]

Powyższy warunek mówi, że większość mas miar \(\mu_t\) jest skupiona w pobliżu siebie.

Przykład 24.11 Niech \(T = [1,+\infty)\) i niech \(\mu_t\) będzie rozkładem wykładniczym z parametrem \(t\). Wówczas rodzina miar \(\{\mu_t\}_{t \in T}\) jest ciasna. Dla \(k\in \mathbb{N}\) oraz \(t \in T\) mamy \[\begin{equation*} \mu_t([0,k]) = 1-e^{-tk}\geq 1-e^{-k} \geq 1-\varepsilon \end{equation*}\] gdzie ostatnia nierówność jest spełniona o ile \(k \geq \log(1/\varepsilon)\). Zbiór \(K = [0,k]\) jest więc świadkiem na to, że \(\{ \mu_t\}_{t \in T}\) jest istotnie ciasna.

Rodziny miar, które nie są ciasne charakteryzują się tym, że rozkłady skupione są na zbiorach, których suma mnogościowa jest nieograniczonym zbiorem \(\mathbb{R}^d\).

Przykład 24.12 Niech \(T=\mathbb{N}\) oraz niech \(\mu_n = \mathcal{N}(n,1)\). Dla wygody oznaczmy przez \(X_n\) zmienną losową o rozkładzie \(\mu_n\). Wówczas \[\begin{equation*} \mu_n([n-2,n+2]) = \mathbb{P}[|X_n-n|\leq 2]. \end{equation*}\] Z nierówności Czebyszewa \[\begin{equation*} \mathbb{P}[|X_n-n|\geq 2]\leq 1/4. \end{equation*}\] czyli \[\begin{equation*} \mu_n([n-2,n+2]) \geq 3/4. \end{equation*}\] Dla każdego zwartego \(K \subseteq \mathbb{R}\) znajdziemy zawsze takie \(n \in \mathbb{N}\), że \(K \cap [n-2, n+2] = \emptyset\). Wówczas \[\begin{equation*} \mu_n(K) \leq 1/4. \end{equation*}\] Rodzina \(\{\mu_n\}_{n \in \mathbb{N}}\) nie jest zatem ciasna.

Przykład 24.13 Niech \(\{X_t\}_{t\in T}\) będzie rodziną zmiennych losowych takich, że istnieje \(\delta >0\): \[ \sup_{t\in T}\mathbb{E}|X_t|^\delta = M < \infty. \] Wtedy rodzina \(\{\mu_{X_t}\}\) jest ciasna.

Mianowicie, ustalmy \(\varepsilon>0\), wówczas dla każdego \(t\in T\) \[ \mu_t\big( [-n,n]^c\big) = \mathbb{P}[|X_t|>n] \le \mathbb{P}\big[|X_t|^{\delta}>n^{\delta}\big] \le \frac{\mathbb{E} |X_t|^\delta}{n^\delta} \le \frac{M}{n^\delta} < \varepsilon \] dla dużych wartości \(n\).

Twierdzenie 24.7 (Prochorowa) Rodzina rozkładów prawdopodobieństwa jest ciasna wtedy i tylko wtedy, gdy z każdego ciągu elementów tej rodziny można wybrać podciąg słabo zbieżny do pewnego rozkładu prawdopodobieństwa.

Yuri Vasilyevich Prokhorov (1929-2013)

Proof. Niech \(F_n\) będzie ciasnym ciągiem dystrybuant. Z twierdzenia Helly’ego istnieje podciąg \(F_{n_k}\) zbieżny do pewnej dystrybuanty \(F\) (być może ułomnej). Z założenia ciasności dla każdego \(\varepsilon > 0\) istnieją punkty \(M_{\varepsilon}\) i \(-M_{\varepsilon}\) takie, że

- \(M_{\varepsilon}\) i \(-M_{\varepsilon}\) są punktami ciągłości \(F\);

- \(F_{n_k}(M_{\varepsilon}) - F_{n_k}(-M_{\varepsilon})\ge 1-\varepsilon\) dla każdego \(n_k\).

Zatem przechodząc do granicy \[\lim_{x\to\infty} F(x) - \lim_{x\to-\infty} F(x) \ge F(M_{\varepsilon}) - F(-M_{\varepsilon}) \ge 1-\varepsilon. \] Z dowolności \(\varepsilon\), \(F\) jest dystrybuantą (nie ułomną!) pewnego rozkładu a.

Załóżmy teraz, że z każdego ciągu elementów tej rodziny można wybrać podciąg słabo zbieżny do pewnego rozkładu a. Przypuśćmy, że rodzina miar nie jest ciasna, a więc istnieje \(\varepsilon > 0\), ciąg miar \(\mu_n\) oraz liczby \(M_n\nearrow \infty\) takie, że \[ \mu_n([-M_n,M_n]) <1-\varepsilon. \] Zgodnie z założeniem istnieje podciąg miar \(\mu_{n_k}\) słabo zbieżny do pewnej miary probabilistycznej \(\mu\). Weźmy zbiór postaci \((-N,N)\) taki, że \(\mu(-N,N) > 1-\varepsilon\). Wówczas korzystając z twierdzenia Portmanteau: \[ 1-\varepsilon < \mu(-N,N) \le \liminf \mu_{n_k}(-N,N) \le \liminf \mu_{n_k} ([-M_k, M_k]) \le 1-\varepsilon, \] co doprowadza nas do sprzeczności, zatem rodzina tych miar musi być ciasna.